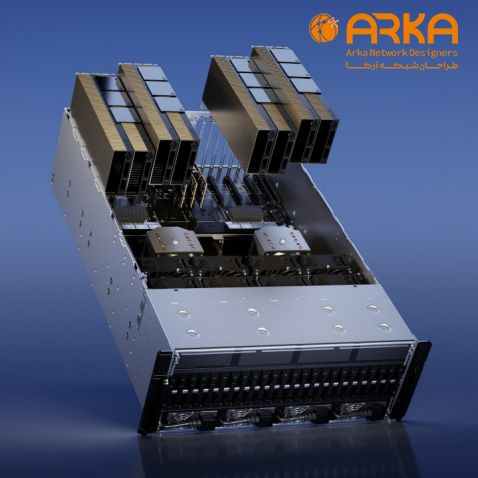

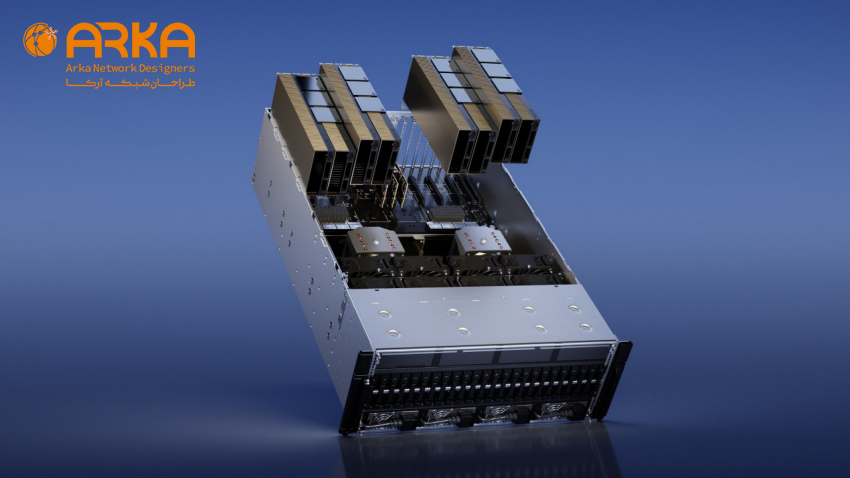

بررسی-NVIDIA-H100 یکی از چشمگیرترین پیشرفتها در پردازش هوش مصنوعی و محاسبات سنگین است. این GPU بر پایه معماری قدرتمند Hopper ساخته شده و با ویژگیهایی همچون Tensor Core نسل چهارم، Transformer Engine، و حافظه سریع HBM3 در نسخههای SXM و PCIe، عملکردی انقلابی ارائه میدهد.

معماری Hopper و مشخصهها

معماری Hopper با فناوری TSMC 4N شامل بیش از 80 میلیارد ترانزیستور است.

-

Tensor Core نسل چهارم: تا 6× سریعتر از A100 در Chip-to-Chip، دو برابر نرخ MMA و 4× با FP8

-

Transformer Engine: سرعت آموزش مدلهای ترنسفورمر تا 9× افزایش و استنتاج تا 30× سریعتر

-

DPX instructions: سرعت الگوریتمهای برنامهنویسی پویا (مانند Smith-Waterman) تا 7× افزایش

حافظه HBM3 و پهنایباند

H100 اولین GPU است که از حافظه HBM3 با حدود 80 GB و پهنایباند ~3TB/s استفاده میکند.

نسخه PCIe نیز دارای HBM2e و پهنایباند >2 TB/s است.

در نسخه SXM، پهنایباند تا حدود 3 TB/s افزایش مییابد.

کارایی GPU–GPU و توزیع محاسبات

NVLink نسل چهارم امکان ارتباط GPU به GPU با پهنایباند 900GB/s را فراهم میآورد.

PCIe Gen5 و InfiniBand Quantum-2 NDR با Magnum IO به تسهیل توزیع پردازش کمک میکنند.

MIG نسل دوم امکان تقسیم GPU به چند instance امن را با 3× قدرت محاسباتی و 2× پهنایباند فراهم میکند.

کارایی واقعی: آموزش و استنتاج

بررسی-GPU-H100 نشان میدهد که H100 نسبت به A100 در آموزش GPT‑3 حدود 4× سریعتر عمل میکند.

در استنتاج، تا 30× سریعتر با تأخیر بسیار پایین دارد.

کاربردها و کاربردهای پیشرفته

-

هوش مصنوعی و LLM: آموزش و استنتاج مدلهایی مانند GPT، Llama تا 9× سریعتر

-

HPC و شبیهسازی: کارایی FP64 تا 30 TFLOPS (SXM)، تسریع تا 3× نسبت به A100

-

دیتاسنترهای ابری: پشتیبانی کامل از NVIDIA AI Enterprise، امنیت بهروز و سرعت بالا

-

پلتفرمهای DGX و SuperPOD: امکان اتصال با NVSwitch برای کاربردهای گسترده بزرگ مقیاس

نتیجهگیری – پایان بررسی GPU NVIDIA H100

بررسی-GPU-H100 نشان میدهد که این محصول یک جهش عظیم در پردازش AI و محاسبات پیشرفته است. با معماری Hopper، حافظه HBM3 سریع، Tensor Core نسل چهارم، قابلیت تقسیم GPU به بخشهای مستقل و کارایی خیرهکننده در آموزش و استنتاج، NVIDIA H100 استانداردی جدید تعریف کرده است. اگر بهدنبال بالاترین توان محاسباتی هوش مصنوعی هستی، H100 یکی از مطمئنترین انتخابهاست.