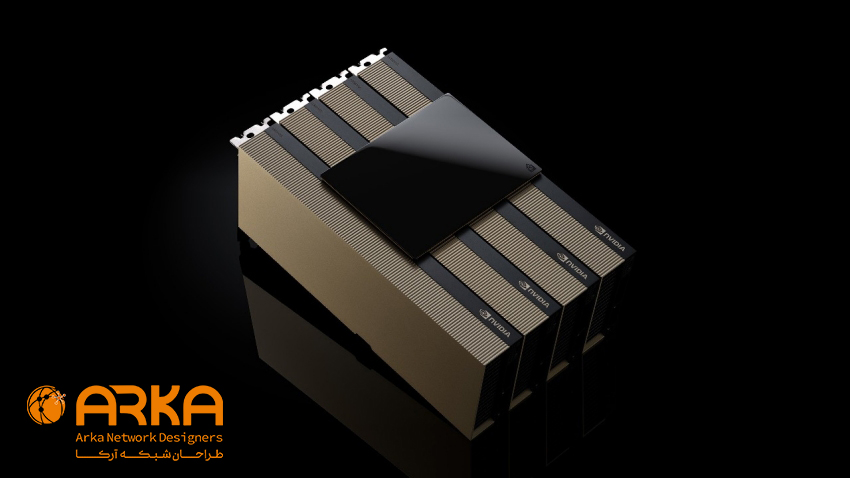

NVIDIA-H200 یکی از مهمترین نقاط عطف در تاریخ پردازشهای موازی و هوش مصنوعی است. کارت گرافیک NVIDIA H200 Tensor Core GPU با استفاده از معماری Hopper طراحی شده و به عنوان جانشین طبیعی H100 شناخته میشود. این پردازنده گرافیکی با برخورداری از 141 گیگابایت حافظه HBM3e و پهنایباند بینظیر 4.8 ترابایت بر ثانیه، مرزهای سرعت و مقیاسپذیری در آموزش و استنتاج مدلهای بزرگ را جابجا کرده است.

حافظه و پهنایباند در NVIDIA H200

یکی از کلیدیترین ویژگیها در بررسی-NVIDIA-H200 ظرفیت بالای حافظه آن است. این GPU به 141GB حافظه HBM3e مجهز شده که نسبت به H100 با حافظه 80GB، پیشرفتی چشمگیر به شمار میآید.

پهنایباند 4.8TB/s این امکان را فراهم میکند که دادهها با سرعتی فوقالعاده میان هستهها و حافظه جابجا شوند. نتیجه این معماری، افزایش چشمگیر در سرعت آموزش مدلهای زبانی بزرگ (LLMs)، مدلهای تصویری و کاربردهای HPC خواهد بود.

مقایسه NVIDIA H200 و H100

در بررسی-GPU-H200 مقایسه با H100 بسیار اهمیت دارد. H100 با وجود قدرت بالایش، در برابر H200 یک قدم عقبتر قرار میگیرد.

-

حافظه: H200 با 141GB در مقابل H100 با 80GB

-

پهنایباند: 4.8TB/s در مقابل 3.35TB/s

-

کارایی استنتاج: H200 در اجرای مدلهایی مانند Llama 2 70B تا 2 برابر سریعتر از H100 عمل میکند

-

HPC: افزایش کارایی تا 110 برابر در برخی پردازشها نسبت به نسل قبل گزارش شده است

این تفاوتها به وضوح نشان میدهند که بررسی-هوش-مصنوعی در نسل جدید GPU انویدیا با H200 مسیر تازهای را آغاز کرده است.

معماری Hopper در NVIDIA H200

بررسی-NVIDIA-H200 بدون تحلیل معماری Hopper کامل نمیشود. این معماری بر پایه فناوری 4 نانومتری TSMC ساخته شده و بیش از 80 میلیارد ترانزیستور را در خود جای داده است. ویژگی برجسته Hopper وجود Transformer Engine است که به صورت اختصاصی برای شتاببخشی به مدلهای Transformer طراحی شده؛ مدلی که پایه و اساس اغلب LLMهای مدرن مانند GPT و BERT است.

ویژگیهای کلیدی معماری Hopper در H200:

-

Tensor Core نسل چهارم با قابلیت پردازش FP8، FP16، BF16 و TF32

-

پشتیبانی از Multi-Instance GPU (MIG) برای تقسیم GPU به چند بخش مستقل

-

امنیت دادهها با Confidential Computing

-

NVLink و NVSwitch برای اتصال چندین GPU در مقیاس دیتاسنتری

نقش H200 در دیتاسنترها و ابررایانهها

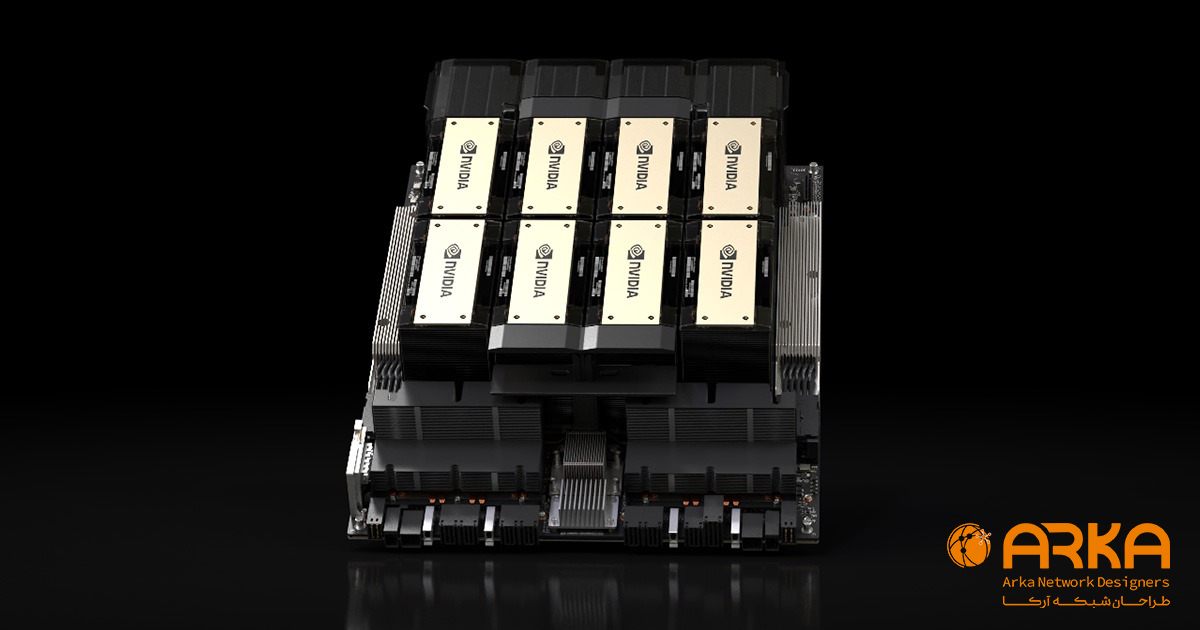

بررسی-سرور-H200 نشان میدهد که این GPU به صورت گسترده در دیتاسنترها و سیستمهای ابری مورد استفاده قرار خواهد گرفت. پلتفرم DGX H200 شامل 8 عدد H200 متصل با NVSwitch است که توان پردازشی در حدود 32 پتافلاپس AI را ارائه میدهد.

نمونه واقعی کاربرد:

-

ABCI 3.0 در ژاپن با استفاده از بیش از 6000 عدد H200، توان محاسباتی بیسابقهای در سطح 6.22 اگزافلاپس (fp16) به دست آورده است.

-

ابررایانههای تحقیقاتی اروپا و آمریکا نیز به سرعت به سمت استفاده از H200 حرکت کردهاند تا مدلهای عظیم مولد (Generative AI) را آموزش دهند.

کاربردهای تخصصی NVIDIA H200

بررسی-NVIDIA-H200 نشان میدهد که این GPU فراتر از یک کارت گرافیک است و برای طیف وسیعی از کاربردها طراحی شده:

-

هوش مصنوعی مولد (Generative AI): آموزش LLMها، مدلهای تصویری Stable Diffusion، و مدلهای صوتی پیشرفته

-

محاسبات علمی (HPC): شبیهسازیهای مولکولی، تحلیل دادههای فضایی و پردازش دادههای اقلیمی

-

دیتاسنترهای ابری: ارائه سرویس GPU as a Service در مقیاس وسیع

-

خودروهای خودران: پردازش بلادرنگ دادههای سنسوری

-

سلامت و بیوانفورماتیک: تحلیل ژنوم، کشف دارو و مدلسازی پروتئینها

مزایای کلیدی برای سازمانها و شرکتها

شرکتهایی که به دنبال استقرار بررسی-GPU-H200 در زیرساخت خود هستند، مزایای زیر را به دست میآورند:

-

کاهش زمان آموزش مدلهای LLM از هفتهها به روزها

-

افزایش بهرهوری انرژی نسبت به عملکرد

-

امکان اجرای مدلهای بسیار بزرگ بدون نیاز به تقسیم بیش از حد پارامترها

-

انعطاف در استقرار در سرورهای مختلف (PCIe و SXM)

آینده با NVIDIA H200

آینده پردازشهای هوش مصنوعی با بررسی-هوش-مصنوعی و ورود H200 متحول خواهد شد. این GPU نه تنها نسل جدید مدلهای AI را ممکن میسازد، بلکه با ظرفیت حافظه و سرعت انتقال داده فوقالعاده خود، پایهای برای پیشرفتهای بعدی مانند NVIDIA GB200 و پردازشهای اگزافلاپی در ابررایانهها خواهد بود.

نتیجه نهایی بررسی GPU NVIDIA H200

بررسی-NVIDIA-H200 به وضوح نشان میدهد که این GPU یک انقلاب واقعی در صنعت هوش مصنوعی و HPC است. با حافظه 141 گیگابایت HBM3e، پهنایباند 4.8 ترابایت بر ثانیه، معماری Hopper و توانایی استنتاج 2 برابر سریعتر نسبت به H100، کارت گرافیک H200 آینده دیتاسنترها، آزمایشگاهها و صنایع مختلف را شکل خواهد داد.