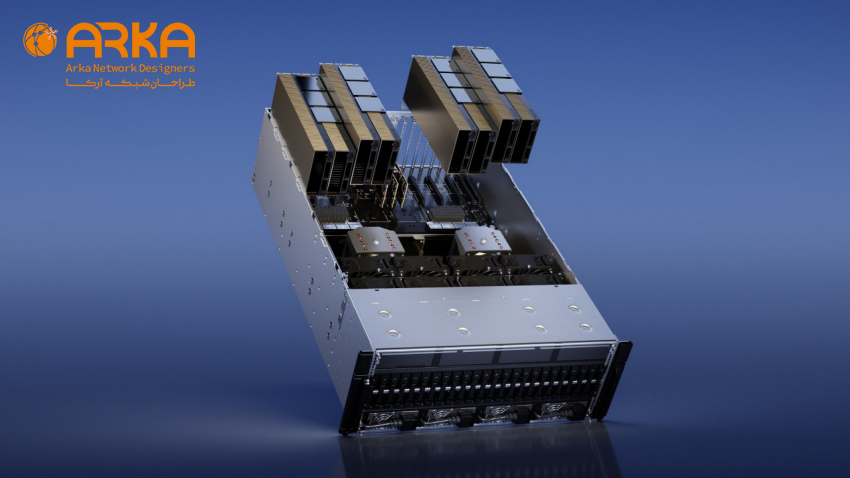

مقایسه NVIDIA H100 و H200 یکی از مهمترین موضوعات دنیای فناوری امروز است. دو نسل از پردازندههای گرافیکی دیتاسنتری شرکت انویدیا که هر دو بر پایه معماری قدرتمند Hopper ساخته شدهاند، اما تفاوتهای کلیدی میان آنها باعث شده تا H200 بهعنوان نقطه عطفی در تاریخ پردازش هوش مصنوعی و HPC شناخته شود. در حالی که H100 با عرضه خود در سال 2022 توانست استانداردهای جدیدی در آموزش مدلهای بزرگ هوش مصنوعی معرفی کند، H200 در سال 2023 با افزایش چشمگیر ظرفیت حافظه و پهنایباند، مسیر را برای مدلهای عظیمتر و پیچیدهتر باز کرده است.

بررسی معماری مشترک NVIDIA H100 و H200

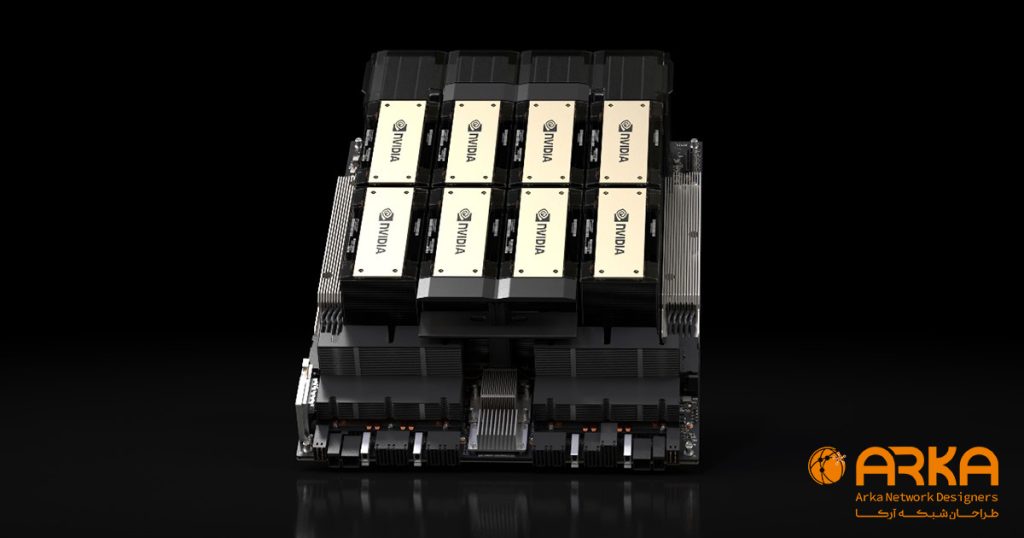

هر دو GPU بر اساس معماری Hopper ساخته شدهاند. این معماری با بیش از 80 میلیارد ترانزیستور و فناوری ساخت 4 نانومتری TSMC N4، پایهای برای نسل جدید پردازشهای موازی فراهم کرده است. در بررسی-GPU-H100-H200 میبینیم که هر دو دارای نسل چهارم Tensor Core هستند. این هستهها امکان پردازش با دقتهای مختلف (FP8، FP16، BF16، TF32) را فراهم میکنند و به کمک Transformer Engine میتوانند مدلهای ترنسفورمر مانند GPT و BERT را با سرعتی بیسابقه آموزش دهند.

یکی دیگر از نقاط مشترک در بررسی-هوش-مصنوعی وجود قابلیت DPX instructions است که برای شتابدهی به الگوریتمهای برنامهنویسی پویا در علوم زیستی و بیوانفورماتیک به کار میرود. همچنین هر دو GPU از قابلیت Multi-Instance GPU یا MIG نسل دوم بهره میبرند که اجازه میدهد یک GPU به چندین بخش مستقل تقسیم شود. این قابلیت برای دیتاسنترها که نیاز به اشتراکگذاری GPU میان چند کاربر دارند، حیاتی است.

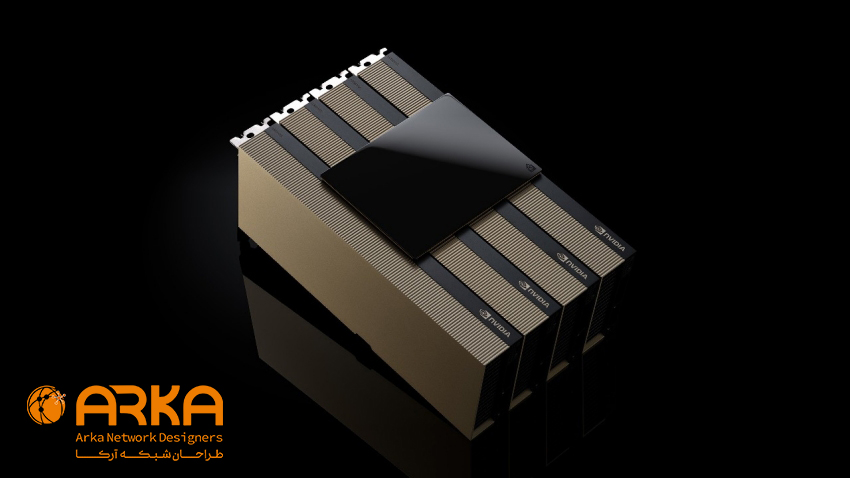

بررسی حافظه: تفاوت کلیدی H100 و H200

بررسی-NVIDIA-H100-vs-H200 نشان میدهد که بزرگترین تفاوت این دو نسل در بخش حافظه است.

-

NVIDIA H100: این GPU دارای حافظه HBM3 تا ظرفیت 80 گیگابایت است. پهنایباند حافظه در نسخه SXM حدود 3.35 ترابایت بر ثانیه و در نسخه PCIe کمی کمتر است. این میزان برای آموزش مدلهای بزرگ کافی بود اما محدودیتهایی برای مقیاسهای فراتر ایجاد میکرد.

-

NVIDIA H200: اولین GPU جهان است که از حافظه HBM3e بهره میبرد. ظرفیت آن به 141 گیگابایت رسیده و پهنایباند به 4.8 ترابایت بر ثانیه ارتقا یافته است. این جهش باعث میشود مدلهای زبان بزرگ (LLMs) با پارامترهای بیش از 100 میلیارد، بدون نیاز به تقسیم بیش از حد دادهها، روی یک GPU یا مجموعهای کوچکتر از GPUها آموزش ببینند.

این تفاوت حافظه یعنی در پروژههایی که محدودیت رم عامل اصلی بود، H200 میتواند انقلابی ایجاد کند.

بررسی عملکرد آموزشی و استنتاجی

در بررسی-سرور-H100-H200 عملکرد آنها در آموزش و استنتاج مدلهای AI تفاوت محسوسی دارد.

-

H100: سرعت آموزش مدل GPT-3 نسبت به A100 تا 4 برابر سریعتر است. همچنین در استنتاج، کاهش تأخیر تا 30 برابر مشاهده شده است.

-

H200: به لطف حافظه بیشتر و پهنایباند بالاتر، سرعت استنتاج مدلهایی مانند Llama 2 70B تا 2 برابر سریعتر از H100 است. در HPC نیز H200 کارایی انرژی بالاتری ارائه میدهد. برای مراکز داده که به دنبال کاهش هزینه کل مالکیت (TCO) هستند، H200 انتخابی بهینهتر محسوب میشود.

بررسی ارتباطات GPU به GPU

هر دو کارت از NVLink نسل چهارم بهره میبرند که پهنایباند 900 گیگابایت بر ثانیه میان GPUها فراهم میکند. در حالت NVL، چند GPU به یکدیگر متصل میشوند و یک حافظه اشتراکی بزرگ ایجاد میکنند.

-

در H100 NVL، مجموع حافظه دو کارت به 188 گیگابایت میرسد.

-

در H200 NVL، این مقدار به 282 گیگابایت افزایش یافته و پهنایباند بین GPUها نیز بیشتر شده است.

این پیشرفت به مراکز داده اجازه میدهد سیستمهایی با هزاران GPU متصل به یکدیگر ایجاد کنند که برای آموزش مدلهای فوق عظیم ضروری است.

بررسی کاربردها در صنعت

مقایسه NVIDIA H100 vs H200 نشان میدهد که هر دو GPU برای حوزههای مشابهی طراحی شدهاند، اما H200 در مقیاسهای بزرگتر بهتر عمل میکند.

-

هوش مصنوعی مولد (Generative AI): هر دو GPU برای آموزش مدلهای زبانی و تصویری استفاده میشوند، اما H200 با حافظه بزرگتر میتواند مدلهای عظیمتر را مدیریت کند.

-

HPC و شبیهسازیهای علمی: در محاسبات علمی، H200 توان مصرفی بهینهتری دارد و برای شبیهسازیهای پیچیدهتر بهتر است.

-

دیتاسنترها و سرویسهای ابری: هر دو GPU با پلتفرم NVIDIA AI Enterprise سازگارند، اما H200 به دلیل ظرفیت بالاتر در استقرار GPU-as-a-Service کارایی بیشتری دارد.

-

سلامت و بیوانفورماتیک: پردازش دادههای ژنومی و مدلسازی پروتئینها در H200 سریعتر انجام میشود.

جدول مقایسه NVIDIA H100 و H200

| ویژگی | NVIDIA H100 | NVIDIA H200 |

|---|---|---|

| معماری | Hopper | Hopper |

| حافظه | 80GB HBM3 | 141GB HBM3e |

| پهنایباند | 3.35TB/s | 4.8TB/s |

| آموزش GPT-3 | 4× سریعتر از A100 | سریعتر از H100 |

| استنتاج Llama2 70B | – | 2× سریعتر از H100 |

| ارتباط GPU | NVLink 900GB/s | NVLink 1.8TB/s (NVL) |

| کارایی انرژی | بسیار بالا | بهینهتر |

| مناسب برای | AI، HPC، Cloud | AI عظیممقیاس، HPC، Cloud |

نتیجهگیری نهایی بررسی NVIDIA H100 vs H200

نتیجه بررسی NVIDIA H100 و NVIDIA H200 نشان میدهد که هر دو GPU شاهکارهای مهندسی هستند، اما H200 با حافظه بیشتر، پهنایباند سریعتر و عملکرد بهتر در استنتاج، گزینهای آیندهنگرانهتر برای دیتاسنترها و پروژههای هوش مصنوعی مقیاس بزرگ محسوب میشود. H100 همچنان GPU قدرتمندی است که بسیاری از مراکز داده از آن استفاده میکنند، اما اگر هدف آموزش و استنتاج مدلهای عظیم نسل بعدی باشد، H200 بهترین انتخاب خواهد بود.